Gäller försäkringen när AI hallucinerar?

Går det att försäkra sig mot att chatbotar hittar på rabatter? En marknad för renodlade AI-försäkringar, ofta utfärdade av renodlade AI-försäkringsbolag, tycks vara på framväxt.

Många företag betraktar AI som en av de största säkerhetsriskerna. Lagstiftningen skärps samtidigt som antalet incidenter och tvister kopplade till AI-användning ökar. Allmänna försäkringar och cyberförsäkringar är vaga, och nu försöker nya aktörer lösa problemet med Silent AI. En kort sammanfattning av utvecklingen:

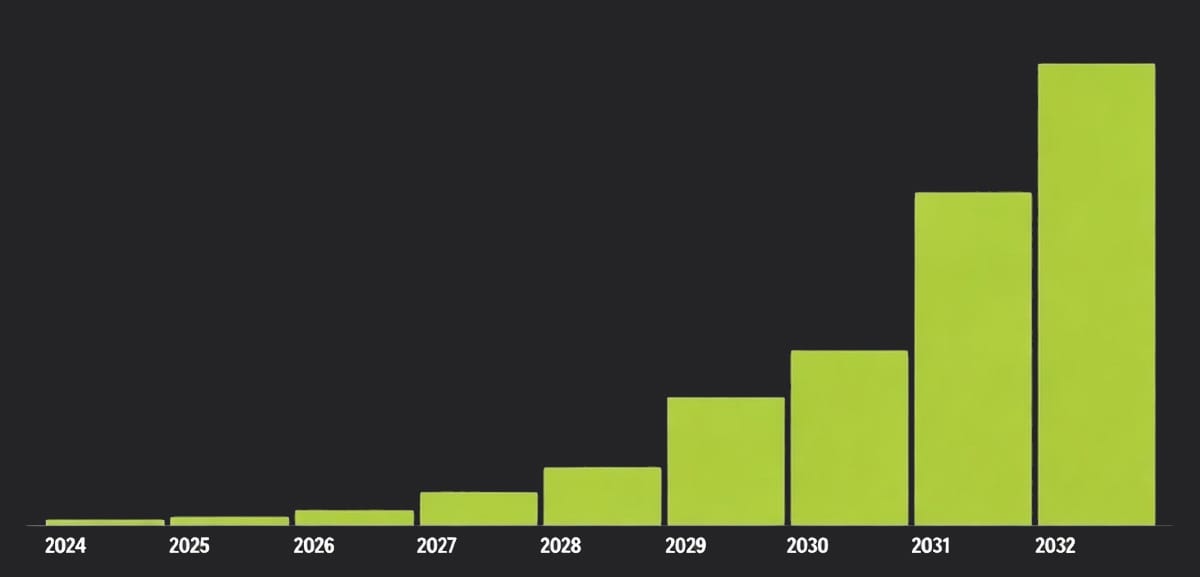

Växande problem och växande marknad

Rådgivare har hållts ansvariga vid ett antal tillfällen. En domstol fann att Air Canada var ansvarigt för en påhittad rabattpolicy. Deloitte blev återbetalningsskyldigt efter att ha överlämnat en konsultrapport full med fabricerade citat och referenser. Advokater har fällts för att ha lämnat in inlagor med hallucinerad praxis, både utomlands och i Sverige.

Problemet är växande, antalet stämningar relaterade till generativ AI ökade markant under förra året. Marknaden för AI-försäkringar uppskattas växa med 80 procent årligen.

AI-specifika försäkringar och produktförsäkringar för botar

På senare år har försäkringsföretag börjat erbjuda specifika försäkringar för AI-användning. Armilla, som specialiserat sig inom AI-ansvarsförsäkring och som är coverholder för Lloyd's of London, täcker exempelvis sedan ett par år upp till 25 miljoner dollar per organisation.

Nu kommer även försäkringar för chatbotar och andra AI-agenter. Elevenlabs, som använts för att ta fram explainervideon ovan och vars agenter används av företag som McKinsey, Stripe, Cisco, Nvidia och Disney, meddelade nyligen att företagets agenter kan försäkras efter certifiering av Artificial Intelligence Underwriting Company.

Försäkringen täcker exempelvis situationer då agenten lämnat felaktig information eller går emot skyddsmekanismer. Agenterna certifieras genom tusentals adversariala tester.

Inga AI-specifika försäkringsvillkor för jurister - än

Problemet med otydliga villkor och "silent AI" berör inte minst kunskapsdrivna branscher.

- Det här är otroligt intressanta frågor som alla konsulter ställer sig just nu, säger Joakim Borg vid försäkringsförmedlaren Willis Towers Watson Sweden.

För just advokater är beskedet tydligt, rådgivningsansvaret gäller fullt ut. De obligatoriska försäkringarna täcker skadeståndsansvar oavsett vad som utlöst ansvaret.

AI regleras inte särskilt, men AI-relaterade skador är heller inte undantagna:

- Skulle man inte täcka AI-relaterade fel har man inget klientskydd. Men det finns ingen särskild klausul, det skulle inte innebära någon fördel för advokater eller klienter. Börjar man specificera innebär det att man sätter en ram runt skyddet, säger Borg.

- Det här är en växande risk som konstant utvecklas och vi följer den utvecklingen noggrant i syfte att anpassa det skydd vi erbjuder för våra kunder. Vi har inget specifikt undantag för AI som orsakar en fysisk skada så som brand- eller vattenskador och vår cyberförsäkring täcker kostnader och avbrott till följd av dataintrång, vare sig det sker via AI eller på annat sätt, säger Cecilia Magnusson vid Trygg-Hansa.

Den typen av undantag har dock börjat dyka upp i andra försäkringsbolags villkor. Sedan juli 2025 täcker exempelvis Berkley inte AI automatiskt. Den som vill ha täckning behöver numera kunna visa att utdata granskas av kvalificerad personal och att AI-system inventeras och riskbedöms.

"Hallucinationer" är bara början

Det finns en dimension till i detta - leverantörernas produktansvar för mer självständig, agentisk AI. Utvecklingen går nu mot mer autonoma agenter som utför komplexa kedjor av uppgifter, mer självständigt och mer integrerat med övriga verktyg och arbetsprocesser. De minns, de kan fatta beslut och styra projekt, hålla koll på deadlines, hantera tidredovisning, identifiera styrkor och svagheter i argumentation och kommunicera med klienter.

Vad händer när de vidtar bindande rättshandlingar som inte varit avsedda, eller orsakar skador på andra sätt? Som när en av Googles AI-agenter oåterkalleligt raderade en disk efter ett missförstånd förra året? Mer subtila fel som är svårare att upptäcka skulle kunna vara felklassificeringar, missade datum och blinda fläckar i argumentation. Detta kräver mer än kontroll av rättsfallsreferenser i utdata efter en enskild ChatGPT-prompt.

University of Chicago Law Review har publicerat en analys som argumenterar för att agenter bör behandlas som "riskfyllda agenter utan intentioner" och att den som använder en AI-agent inte bör kunna hävda att de inte visste vad agenten gjorde - principalen bär ansvaret. I en annan färsk artikel - Agents of Chaos - argumenterar forskare vid en rad prestigefulla universitet för att ansvaret är svårdistribuerbart med nuvarande agentarkitekturer.

Juridiska rådgivare har börjat implementera agentisk AI från Thomson Reuters CoCounsel, Harvey, Legora, Clio, Saga m fl. Att försäkringar "täcker AI-användning" säger inte så mycket - vad täcker försäkringarna när en byrå upphandlat och implementerat enligt konstens alla regler och den enskilda användaren inte rimligen kunnat upptäcka att agenten gått mot sina guardrails?

Om branschen faktiskt ska kunna utveckla nya arbetssätt och affärsmodeller krävs tillit till verktygen. Enligt en färsk undersökning från Akavia är jurister den medlemsgrupp som är i särklass mest skeptisk till AI, något som bl a förklaras med riskaversion och höga kvalitetskrav. Governanceverktyg, RAG och mänsklig källkritisk granskning finns, men huvudverktyget tycks fortfarande vara att begränsa implementeringen.

Vad gäller i praktiken?

Hur villkor kommer tolkas i "nya" situationer återstår att se. Traditionella försäkringar, cyberförsäkringar, teknik-E&O m.m. är ofta vaga när det gäller AI och riskerar i praktiken att lämna kunden skyddslös. De omfattar inte AI uttryckligen, och nu kommer uttryckliga undantag.

Situationen påminner om hur cyberhot hanterades tidigt 00-tal innan renodlade cyberförsäkringar existerade. Och på liknande sätt som då börjar traditionella försäkringsbolag som AIG och WR Berkley aktivt skriva in AI-undantag i avtalen. Incidenterna är kostsamma, och black box-problematiken kvarstår. Samtidigt: om företag kan lätta på bromsen är potentialen uppenbar. Det kanske är det försäkringsbranschens nya aktörer förstått.